Ética y regulación en el desarrollo robótico

A medida que los robots se vuelven más autónomos, inteligentes y omnipresentes en nuestra sociedad, surgen preguntas fundamentales sobre cómo asegurar que estas tecnologías beneficien a la humanidad y minimicen los riesgos potenciales. La ética robótica y los marcos regulatorios adecuados son esenciales para guiar el desarrollo responsable de estas poderosas tecnologías.

Las tres leyes y más allá: evolución de la ética robótica

Cuando se habla de ética en robótica, es casi inevitable mencionar las Tres Leyes de la Robótica formuladas por Isaac Asimov en sus obras de ciencia ficción. Estas leyes, que establecen que un robot no debe dañar a un humano, debe obedecer órdenes y debe proteger su propia existencia (en ese orden de prioridad), han sido un punto de referencia cultural importante.

Sin embargo, la realidad de la ética robótica contemporánea es mucho más compleja. Los sistemas robóticos modernos operan en contextos sociales complicados donde los conceptos de "daño" y "bienestar" son multidimensionales y a veces contradictorios.

Los eticistas y expertos en tecnología actuales están desarrollando marcos más sofisticados que abordan cuestiones como la autonomía, la transparencia, la privacidad, la responsabilidad y la justicia distributiva. Estos marcos buscan equilibrar la innovación tecnológica con la protección de valores humanos fundamentales.

Expertos debatiendo sobre ética robótica en una conferencia internacional

Dilemas éticos en sistemas autónomos

Los robots y sistemas autónomos plantean dilemas éticos únicos que no tienen precedentes claros en tecnologías anteriores. Uno de los más discutidos es el "problema del tranvía" aplicado a vehículos autónomos: ¿cómo debería un coche sin conductor responder ante una situación inevitable de accidente donde debe "elegir" entre diferentes resultados perjudiciales?

Otro dilema importante surge en el contexto militar, donde los sistemas de armas autónomas podrían potencialmente tomar decisiones sobre vida o muerte sin supervisión humana directa. Muchos expertos y organizaciones abogan por mantener un "control humano significativo" sobre tales sistemas.

Los robots sociales y asistenciales plantean cuestiones sobre el engaño y la manipulación: ¿es ético diseñar robots que simulen emociones o conexiones personales para lograr mejores resultados en entornos de cuidado? ¿Podría esta "intimidad simulada" afectar negativamente a personas vulnerables como niños o ancianos?

"La pregunta no es si los robots reflejarán nuestros valores sociales y éticos, sino qué valores elegirán reflejar quienes los diseñen y programen." - Wendell Wallach, especialista en ética tecnológica

Privacidad y vigilancia en la era robótica

Los robots modernos son, en esencia, plataformas de recopilación de datos. Equipados con cámaras, micrófonos y diversos sensores, pueden reunir información detallada sobre su entorno y las personas que interactúan con ellos. Esto plantea serias preocupaciones sobre privacidad y vigilancia.

En entornos domésticos, los robots aspiradores, asistentes personales y otros dispositivos tienen acceso a información íntima sobre nuestros hogares y hábitos. En espacios públicos, robots de seguridad y sistemas de vigilancia automatizados pueden monitorear el comportamiento de las personas sin consentimiento explícito.

Los marcos regulatorios como el Reglamento General de Protección de Datos (RGPD) en Europa ofrecen cierta protección, pero muchos expertos argumentan que se necesitan regulaciones específicas para robótica que aborden las características únicas de estas tecnologías.

Robot de seguridad patrullando un centro comercial, ilustrando las preocupaciones sobre vigilancia y privacidad

Responsabilidad y rendición de cuentas

Cuando un sistema robótico autónomo causa daño o toma una decisión incorrecta, ¿quién es responsable? Esta pregunta fundamental se vuelve cada vez más relevante a medida que los robots asumen roles más críticos en la sociedad.

El problema de la responsabilidad se complica por la naturaleza distribuida de los sistemas robóticos modernos, que a menudo involucran múltiples actores: fabricantes de hardware, desarrolladores de software, proveedores de datos, operadores y usuarios finales. Además, los sistemas que utilizan aprendizaje automático pueden desarrollar comportamientos que no fueron explícitamente programados.

Algunas propuestas incluyen modelos de "responsabilidad compartida", regímenes de seguros especializados, o incluso la creación de algún tipo de "personalidad electrónica" para sistemas altamente autónomos. Sin embargo, existe consenso en que la tecnología no debe convertirse en una manera de evadir la responsabilidad humana por sus consecuencias.

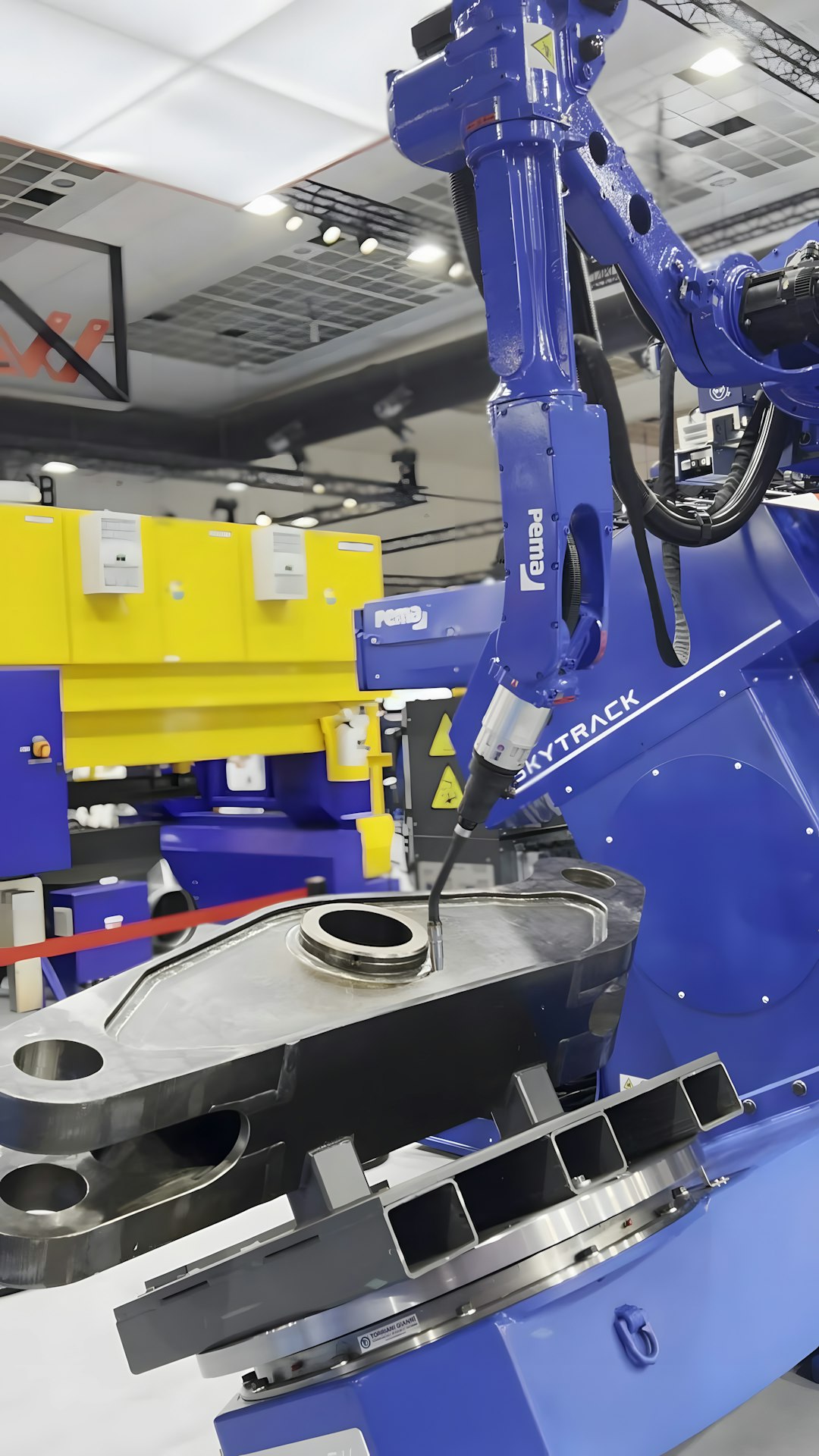

Impacto laboral: transformación, no solo sustitución

Una de las preocupaciones más extendidas sobre la robótica es su impacto en el empleo. Si bien es cierto que la automatización puede desplazar ciertos tipos de trabajos, la historia tecnológica sugiere que también crea nuevas oportunidades laborales y transforma ocupaciones existentes.

El verdadero desafío ético es asegurar que esta transición sea justa y que los beneficios de la automatización se distribuyan ampliamente en la sociedad. Esto implica políticas proactivas de educación y recapacitación, posibles adaptaciones en sistemas de seguridad social, y consideración de conceptos como impuestos a la automatización o renta básica universal.

También es importante diseñar sistemas robóticos que complementen las capacidades humanas en lugar de simplemente reemplazarlas, fomentando modelos de colaboración humano-robot que aprovechen las fortalezas únicas de ambos.

Marcos regulatorios emergentes

Los gobiernos y organizaciones internacionales están comenzando a desarrollar marcos regulatorios específicos para la robótica y la inteligencia artificial. La Unión Europea ha sido pionera con iniciativas como su propuesta de Reglamento de Inteligencia Artificial, que clasifica las aplicaciones de IA por niveles de riesgo y establece requisitos proporcionales.

Otros enfoques incluyen la creación de "sandboxes regulatorios" donde nuevas tecnologías pueden probarse bajo supervisión antes de su despliegue general, o la adopción de estándares técnicos y certificaciones específicas para robótica.

Un desafío importante es balancear la necesidad de protección pública con la de no sofocar la innovación. Los marcos regulatorios demasiado rígidos o prematuros podrían obstaculizar avances beneficiosos, mientras que una regulación insuficiente podría permitir consecuencias no deseadas.

Legisladores y expertos discutiendo marcos regulatorios para tecnologías robóticas avanzadas

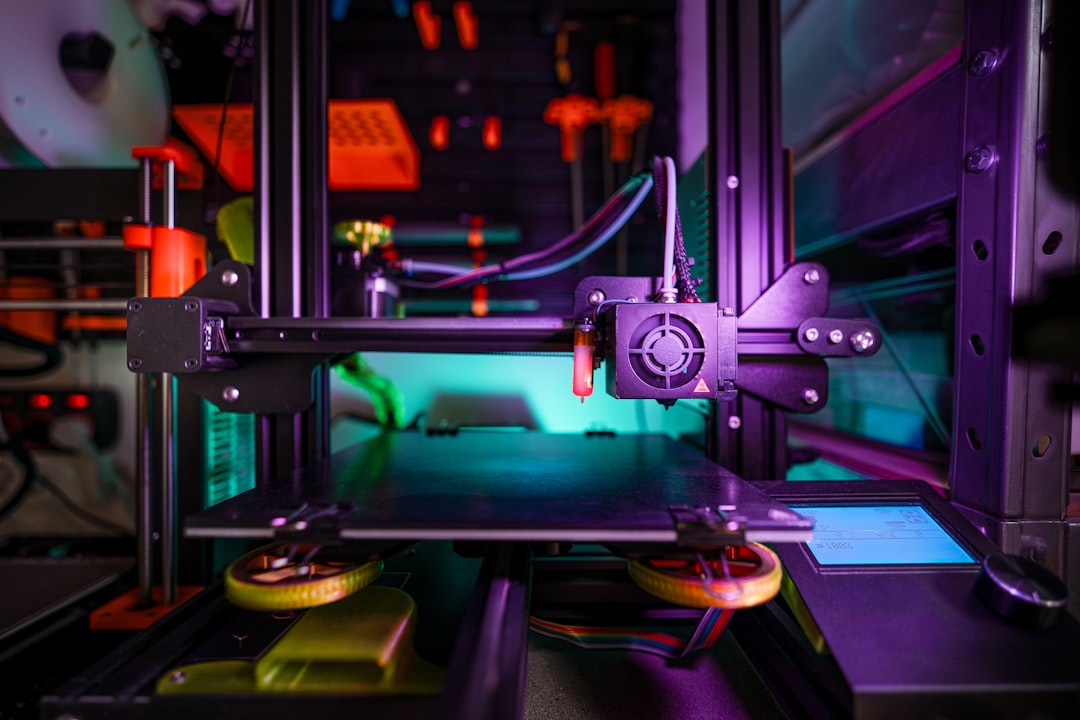

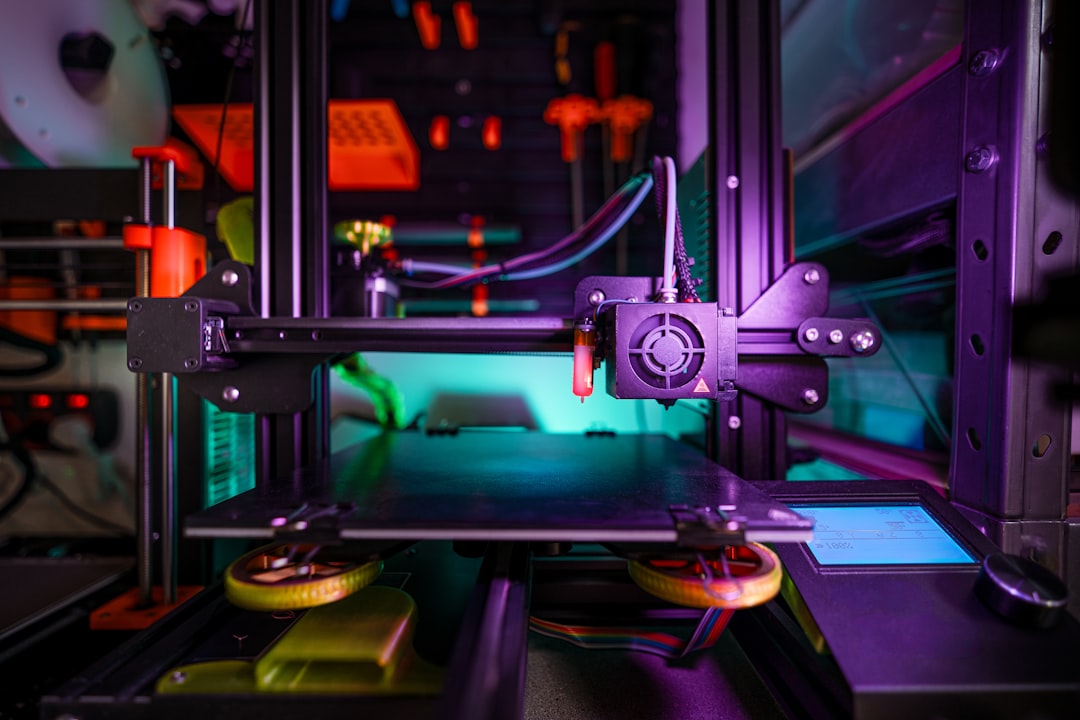

Diseño centrado en valores humanos

Una perspectiva cada vez más influyente es la del "diseño centrado en valores", que propone incorporar consideraciones éticas desde las primeras etapas del proceso de desarrollo tecnológico, en lugar de tratarlas como una reflexión posterior.

Este enfoque implica identificar explícitamente los valores humanos relevantes para una tecnología particular (como privacidad, autonomía, bienestar, justicia) y traducirlos en requisitos concretos de diseño. También requiere procesos participativos que incluyan a diversas partes interesadas en las decisiones de diseño.

Metodologías como la Evaluación de Impacto Ético y la Evaluación de Impacto Algorítmico están ganando aceptación como herramientas prácticas para implementar esta visión de diseño responsable.

Educación y alfabetización robótica

A medida que los robots se vuelven más comunes en nuestras vidas, la educación sobre robótica y sus implicaciones éticas se vuelve crucial para todos los ciudadanos, no solo para especialistas técnicos.

La alfabetización robótica implica comprender no solo cómo funcionan estas tecnologías, sino también sus limitaciones, sesgos potenciales y cómo pueden afectar a individuos y comunidades. Esta comprensión es fundamental para que la sociedad pueda tomar decisiones informadas sobre qué tecnologías adoptar y cómo regularlas.

Las instituciones educativas, desde escuelas primarias hasta universidades, están comenzando a incorporar estos temas en sus currículos, reconociendo que la tecnología robótica es ya una parte fundamental de la ciudadanía contemporánea.

Hacia un futuro robótico responsable

El desarrollo responsable de la robótica no es solo una cuestión técnica, sino un desafío social que requiere la participación de múltiples disciplinas y sectores. Ingenieros, eticistas, legisladores, empresas y ciudadanos tienen roles complementarios que desempeñar.

La buena noticia es que estamos en una etapa temprana, donde todavía podemos dar forma al futuro de estas tecnologías. A diferencia de revoluciones tecnológicas anteriores, existe una conciencia generalizada sobre la importancia de considerar las implicaciones éticas desde el principio.

Con los marcos adecuados de gobernanza, diseño ético y participación pública, la robótica tiene el potencial de convertirse en una fuerza profundamente positiva para la humanidad, mejorando nuestras capacidades mientras respeta y refuerza nuestros valores fundamentales.

Conclusión

La ética y la regulación en robótica no son obstáculos para el progreso tecnológico, sino elementos esenciales para garantizar que este progreso beneficie genuinamente a la humanidad. Al abordar proactivamente cuestiones de privacidad, responsabilidad, impacto laboral y toma de decisiones éticas, podemos construir un futuro donde los robots sean socios confiables en nuestra sociedad.

El camino hacia adelante requerirá diálogo continuo, colaboración interdisciplinaria y adaptación constante a medida que estas tecnologías evolucionen. Pero con compromiso con valores humanos fundamentales como guía, el futuro de la robótica puede ser tan ético como innovador.